Vera Rubin样品的正式交付,标志着NVIDIA新一代AI超级计算平台从发布阶段迈入产业落地阶段。这不仅是一次产品推进,更是企业战略重心的清晰转向。

长期以来,NVIDIA以GPU为核心建立AI训练标准。但在Vera Rubin架构下,其竞争逻辑已发生实质变化——从单一GPU性能优势,转向“CPU+GPU+DPU+高速互联+网络交换”全栈整合能力。

这背后折射出一个更深层次趋势:

AI竞争正在从芯片参数比拼,进入系统级吞吐效率与算力密度的较量。

在超大模型时代,真正决定效率的,不再是理论算力峰值,而是系统耦合后的“有效算力”。

Vera Rubin核心芯片采用台积电第三代3nm(N3P)制程。

这一节点的意义,并不只是“更先进”,而在于工程层面的可控性与能效提升。

相较于5nm/4nm工艺,N3P带来:

更高晶体管密度 → 支撑更多SM与更大缓存

更优功耗控制 → 提升性能/瓦比

更佳频率稳定性 → 有利于高带宽负载

在HBM4高带宽显存与高SM密度并存的背景下,热设计功耗成为系统稳定性的关键变量。

制程先进性在AI时代的真正价值,是在超大规模并行计算场景中维持长期稳定运行。

换言之,制程决定上限,能效决定可持续。

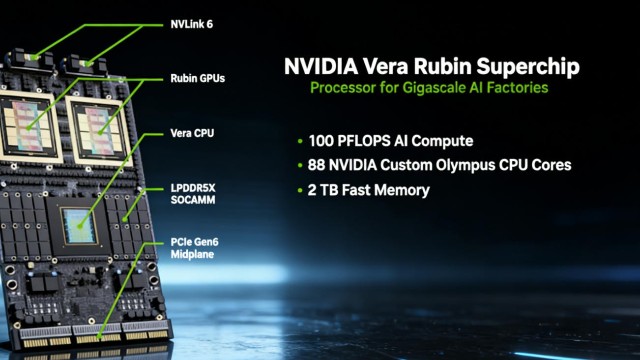

Vera CPU配备88个NVIDIA定制“奥林巴斯”核心,完全兼容Arm架构。这一设计具有深远意义。

首先,这是NVIDIA强化垂直整合的重要一步。

通过自研CPU,企业能够在:

内存一致性协议

GPU-CPU协同调度

NUMA拓扑优化

等关键领域获得更高控制权。

其次,这是针对“AI工厂”场景的专用设计。

传统x86服务器面向通用计算,而Vera CPU更强调数据吞吐与并行调度效率,适配大模型训练与推理负载特征。

再次,Arm在数据中心渗透率持续提升。

NVIDIA强化Arm兼容性,意味着其正为未来数据中心CPU多元化格局提前布局。

这不仅是技术升级,更是生态战略。

Rubin GPU的升级核心体现在三大维度:

SM数量提升带来更高并行度,但真正决定效率的是调度与缓存结构优化。

若架构设计不当,SM增加反而可能降低利用率。因此,此次升级更可能涉及片上缓存体系与调度算法的优化。

在超大模型训练中,显存容量往往早于算力成为瓶颈。

HBM4提供更高带宽与更低功耗,使模型切分次数减少,数据交换频率降低,从而提升训练连续性。

显存容量的提升,本质上是对模型规模扩展的前置支持。

针对混合精度(FP8/FP16/BF16)优化:

动态精度管理

数值稳定性提升

推理延迟下降

这意味着GPU架构正在向“模型原生优化”方向演进,而非通用计算设备。

随着GPU算力指数级提升,通信延迟成为扩展瓶颈。

NVLink 6提供3.6TB/s GPU对GPU带宽,其意义在于:

缩短All-Reduce时间

提高数据并行扩展效率

降低超千卡集群训练时延

在大规模分布式训练中,通信时间可占总训练时间30%以上。

因此,互联能力的提升往往比单卡性能提升更具系统意义。

BlueField-4 DPU集成64核Grace CPU与ConnectX-9高速网络芯片,实现网络卸载与安全隔离。

其工程价值体现在:

将网络协议栈从主CPU中卸载

提升数据路径效率

强化硬件级安全控制

数据中心正在从“计算为中心”转向“数据流为中心”。

谁能更高效地管理数据流动,谁就能提升整体算力利用率。

NVL72整机包含72颗Rubin GPU与36颗Vera CPU。

其系统优势包括:

若完成同等训练任务所需GPU数量减少4倍,说明:

单卡性能显著提升

扩展效率更高

通信损耗降低

这将带来机架密度提升与能耗下降的双重收益。

推理成本下降将:

扩大商业API应用范围

降低企业私有化部署门槛

推动AI服务规模化普及

成本结构的重构,往往比性能提升更具产业意义。

合作伙伴获得样品并启动适配,意味着:

主板与电源设计已重新规划

散热与液冷方案升级

软件栈与驱动提前适配

一旦平台规模部署完成,迁移成本将显著提高,生态锁定效应增强。

这是一种典型的全栈平台战略。

从行业角度看,其影响体现在三方面:

支撑更大规模模型训练

推理成为算力增长主力

竞争进入系统整合能力阶段

当算力从“组件竞争”升级为“体系竞争”,具备全栈能力的厂商更具优势。

未来两年,AI数据中心将面临:

能耗监管趋严

HBM产能约束

定制ASIC竞争加剧

在此背景下,Vera Rubin代表的是一种系统级优化路径:

通过更高带宽、更优能效与更紧耦合架构,实现算力密度最大化。

如果说上一代产品强调算力高度,

那么Vera Rubin更强调算力效率与成本控制。